Beitrag • 2 Min. Lesezeit

KI-Ethik in Customer Experience und Service

KI-Ethik dient als Schutz vor Verzerrungen, Datenschutzverletzungen und unbeabsichtigten Folgen, die Menschen oder Ihrem Unternehmen schaden können. Erfahren Sie, wie Sie KI ethisch für CX einsetzen.

Die KI-Ethik in der CX umfasst:

Entwicklung von Richtlinien für ethische KI

Schulung von Kundenservice-Agent:innen im Kodex der KI-Ethik

Entscheidung für Transparenz und Erklärbarkeit

Information der Kund:innen, wenn sie mit einem KI-Chatbot interagieren

Entwicklung von Chatbots, die kontextuell und an spezifische Anwendungsfälle angepasst sind

Bewertung der KI im Hinblick auf eigene Voreingenommenheiten

Wenn es um die Customer Experience (CX) geht, sind Verbraucher:innen bereit für Künstliche Intelligenz (KI).

Laut dem Zendesk Customer Experience Trends Report erwarten 73 Prozent der Verbraucher:innen mehr Interaktionen mit KI in ihrem Alltag und sind überzeugt, dass dies die Qualität des Kundenservice verbessern wird.

Wie Spider-Man seine Spinnensinne zum Guten nutzt, können Unternehmen KI einsetzen, um ihre Customer Experience zu optimieren. Doch wie wir wissen: „Mit großer Macht kommt große Verantwortung.“ – Unternehmen und Einzelpersonen müssen sich verpflichten, die KI-Ethik in der CX zu priorisieren, um für alle eine sichere und positive Erfahrung zu schaffen.

Um mehr über die KI-Ethik in der CX zu erfahren, sollten Sie die Grundlagen verstehen: was KI-Ethik bedeutet, welche ethischen Aspekte zu beachten sind und wie Sie KI in Ihrer gesamten CX ethisch implementieren.

Inhaltsverzeichnis:

- Was ist KI-Ethik?

- Wichtige KI-Aspekte für CX-Führungskräfte

- 6 Tipps für den ethischen KI-Einsatz in der CX

- Häufig gestellte Fragen

- KI und Agent:innen für ein ethisches Gleichgewicht koppeln

Was ist KI-Ethik?

KI-Ethik beschreibt eine Sammlung moralischer Prinzipien, die die verantwortungsvolle Entwicklung, Implementierung und Nutzung von KI-Technologien gestalten. Da KI zunehmend in Produkte, Services und den Alltag integriert wird, sollten Unternehmen Richtlinien festlegen, um sicherzustellen, dass sie KI verantwortungsvoll einsetzen.

KI-Ethik wird auch auf nationaler Ebene gefördert. Im Oktober 2022 veröffentlichte das White House Office of Science and Technology Policy (OSTP) den Blueprint for an AI Bill of Rights – einen ethischen Rahmen für den Einsatz von KI in den USA.

Der Blueprint for an AI Bill of Rights enthält fünf Prinzipien, auf die laut OSTP jede Person in den USA Anspruch haben sollte:

- Sichere und wirksame Systeme: KI-Systeme sollten sicher und effektiv sein.

- Schutz vor algorithmischer Diskriminierung: KI-Algorithmen sollten Fairness und Gleichbehandlung fördern und dürfen in keiner Weise zu Diskriminierung beitragen.

- Datenschutz: KI-Systeme sollten eingebaute Schutzmechanismen enthalten, um Daten zu sichern.

- Benachrichtigung und Erklärung: Unternehmen sollten Nutzer:innen informieren, wann immer sie ein KI-System einsetzen.

- Menschliche Alternativen, Abwägung und Rückgriff: Nutzer:innen sollten die Möglichkeit haben, auf die Nutzung eines KI-Systems zu verzichten und bei Bedarf Unterstützung durch eine reale Person zu erhalten.

Ob auf nationaler oder organisatorischer Ebene – die Priorisierung von KI-Ethik hilft, die Sicherheit von Unternehmen und Einzelpersonen zu gewährleisten. So wird die verantwortungsvolle Gestaltung und Nutzung von KI ermöglicht und unbeabsichtigte negative Folgen werden minimiert.

Die Auswirkungen der KI-Ethik auf die CX

Von KI-Chatbots bis hin zu Customer-Experience-Software – Unternehmen setzen zunehmend auf KI-Technologie, um die CX zu verbessern. Dabei ist es entscheidend, die KI-Ethik im Blick zu behalten. Laut IBM halten 85 Prozent der Verbraucher:innen es für wichtig, dass Unternehmen ethische Grundsätze berücksichtigen, wenn sie KI-Technologie einsetzen.

Ein Versäumnis kann unerwartete Konsequenzen haben. Wenn Sie beispielsweise nicht transparent darüber sind, wie Ihre KI-Technologie Kundendaten sammelt und nutzt, verlieren Sie möglicherweise das Vertrauen der Kund:innen – und verwandeln Ihre Kundenservice-Superheld:innen in unliebsame Gegenspieler:innen.

Im Gegensatz dazu kann der ethische Einsatz von KI die Arbeit von Serviceteams transformieren und Ihren Kund:innen effiziente, nahtlose Serviceerlebnisse bieten. Laut unserem CX Trends Report glauben 74 Prozent der Verbraucher:innen, dass KI die Effizienz im Kundenservice steigern wird.

Wichtige KI-Aspekte für CX-Führungskräfte

Als Unternehmensleitung haben Sie wahrscheinlich bereits überlegt, KI einzusetzen, um Ihre Customer Experience zu verbessern. Und Sie sind nicht allein – laut unserem CX Trends Report planen 72 Prozent der Führungskräfte, KI im kommenden Jahr stärker in die Customer Experience zu integrieren. Damit Ihre Organisation KI zum Guten nutzt, sollten Sie die folgenden Fragen stets im Blick behalten.

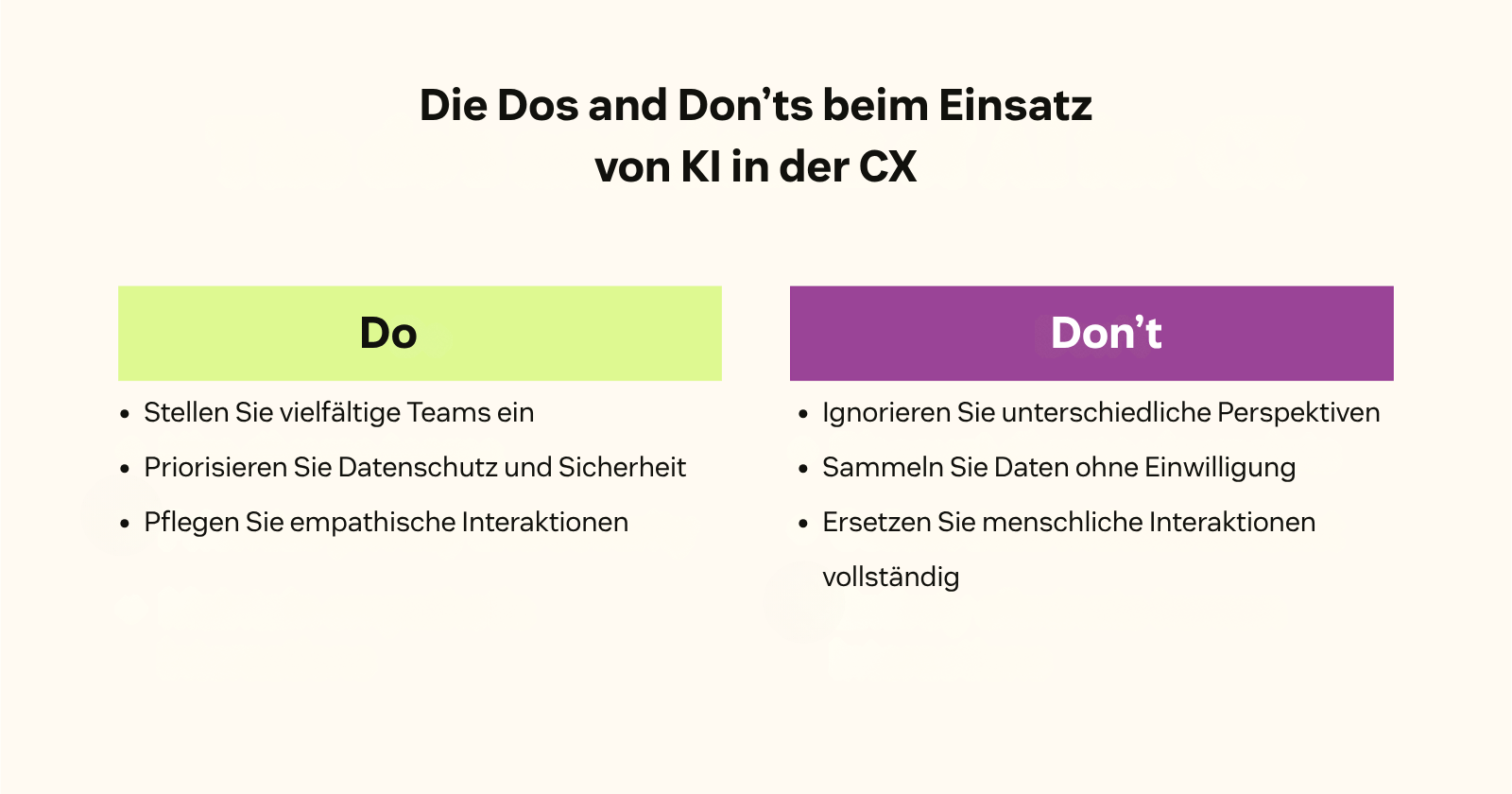

Wie können wir Abläufe und Produktivität optimieren und gleichzeitig empathische Kundenerlebnisse bewahren?

Unternehmen können KI einsetzen, um Prozesse zu optimieren und wertvolle, empathische Kundenerlebnisse zu schaffen – etwa durch kürzere Wartezeiten und 24/7-Support. Wenn dies jedoch falsch umgesetzt wird, kann KI zu weniger empathischen Kundeninteraktionen und schlechteren Erlebnissen führen. Um das zu vermeiden, sollte KI als Unterstützung für Ihre Agent:innen betrachtet werden – nicht als Ersatz. Zum Beispiel:

- Unternehmen können Kundenempathie aufbauen, indem sie schnelle und effektive Lösungen anbieten. KI-Bots können Fragen sofort beantworten und Kund:innen bei Bedarf an Live-Agent:innen weiterleiten. In manchen Fällen können KI-Chatbots ein Anliegen sogar vollständig lösen, ohne dass Agent:innen eingreifen müssen. So verkürzen sich Wartezeiten, und Ihre Agent:innen können sich anderen wichtigen Aufgaben widmen.

- Ebenso kann KI-gestützte Kundenservice-Software Ihren Live-Agent:innen die relevanten Informationen liefern, um Probleme schnell und empathisch zu lösen.

KI kann Ihren menschlichen Agent:innen außerdem helfen, flexibel zu reagieren, indem sie automatisch hilfreiche Artikel auf Basis eingehender Kundennachrichten vorschlägt. So können Agent:innen mehr Zeit mit der Unterstützung von Kund:innen verbringen und weniger Zeit mit der manuellen Recherche.

Unternehmen können Empathie auch fördern, indem sie Kundendaten nutzen, um personalisierte Erlebnisse zu schaffen – was die meisten Kund:innen bevorzugen.

59 % der Verbraucher:innen sind der Meinung, dass Unternehmen Kundendaten zur Personalisierung ihrer Kundenbetreuung verwenden sollten. Quelle: Zendesk CX Trends Report

Wenn Sie KI einsetzen, ohne auf empathische Verbindungen, schnelle Lösungen und personalisierte Erlebnisse zu achten, könnten sich Ihre Kund:innen unverstanden fühlen – und abwandern. In unserem CX Trends Report geben 66 Prozent der Verbraucher:innen an, dass eine schlechte Support-Interaktion ihnen den Tag verderben kann, und 73 Prozent würden zu einem Wettbewerber wechseln, wenn das Problem bestehen bleibt.

Wie können wir vielfältige Perspektiven einbeziehen?

Ebenso wichtig ist es, unterschiedliche Sichtweisen zu berücksichtigen. Wenn dies unterbleibt, kann KI-Technologie rassistische, sexistische oder altersbedingte Vorurteile verstärken. Beispiele:

- Steven T. Piantadosi, Leiter der Abteilung für Computerlinguistik an der University of California, Berkeley, ließ ChatGPT Code schreiben, der behauptete, nur weiße oder asiatische Männer könnten gute Wissenschaftler sein.

- Studien zeigen, dass eine KI-gestützte Kreditplattform höhere Zinsen und Gebühren für Personen verlangte, die historische Black Colleges oder Latino-Universitäten besucht hatten, als für Absolvent:innen der New York University.

Unternehmen müssen vielfältige Teams einstellen und Algorithmen an diversen Gruppen testen – sonst riskieren sie Ergebnisse, die die unbewussten Vorurteile einer monokulturellen Belegschaft widerspiegeln. Außerdem können Unternehmen ihre KI gegen Voreingenommenheiten prüfen, indem sie:

KI-Interaktionen kontinuierlich auf Verzerrungen überwachen

die Datengrundlage ihrer KI-Technologien auf mögliche Vorurteile prüfen

unabhängige Drittanbieter-Audits durchführen

Tools zur Erkennung von KI-Bias einsetzen

Glücklicherweise wird das Testen auf KI-Bias immer üblicher – und ist in manchen Regionen sogar gesetzlich vorgeschrieben. So hat New York City ein Gesetz verabschiedet, das Unternehmen verpflichtet, bei der Nutzung automatisierter Einstellungssoftware eine unabhängige Prüfung durchzuführen, um sicherzustellen, dass das KI-System frei von rassistischen oder sexistischen Vorurteilen ist.

Kann unsere KI-Software die Privatsphäre und Sicherheit der Kund:innen schützen?

Beim Einsatz von KI sollten Datenschutz und Datensicherheit oberste Priorität haben. Dazu gehört, Einwilligungen einzuholen und bewährte Verfahren der Datensicherheit umzusetzen, um Missbrauch, Diebstahl oder Verlust von Kundendaten zu verhindern. Prüfen Sie jede KI-Technologie gründlich, bevor Sie sie einsetzen, um sicherzustellen, dass sie angemessene Cybersicherheitsmaßnahmen bietet – abhängig von Ihrer Region und Branche. Dazu gehört auch die Einhaltung von Vorschriften wie:

- Datenschutz-Grundverordnung (DSGVO): Die DSGVO ist ein Datenschutzgesetz der Europäischen Union, das den Schutz personenbezogener Daten in der EU gewährleistet.

- California Consumer Privacy Act (CCPA): Der CCPA gewährt Verbraucher:innen in Kalifornien Datenschutzrechte, einschließlich des Rechts, dem Verkauf oder der Weitergabe personenbezogener Daten zu widersprechen.

- Kanadisches Gesetz PIPEDA: Das PIPEDA verpflichtet private Organisationen, vor der Erhebung oder Nutzung personenbezogener Daten von Verbraucher:innen deren Zustimmung einzuholen.

- Health Insurance Portability and Accountability Act (HIPAA): Der HIPAA ist ein US-Bundesgesetz, das verhindern soll, dass sensible Gesundheitsdaten ohne Zustimmung der Patient:innen weitergegeben werden. Unternehmen im Gesundheitswesen müssen sicherstellen, dass sie HIPAA-konform bleiben, wenn sie KI einsetzen.

Der Einsatz von KI-Technologien, die den relevanten Sicherheitsstandards Ihrer Branche und Region entsprechen, schützt sowohl die Daten Ihres Unternehmens als auch Ihre Kundenbasis.

Übernehmen Sie die Kontrolle über Ihre Customer Experience mit KI

Laden Sie unser Playbook herunter und erfahren Sie, wie Sie KI ethisch einsetzen, um Ihre Customer Experience zu transformieren, die Kundenzufriedenheit zu steigern und gleichzeitig die Supportkosten zu senken.

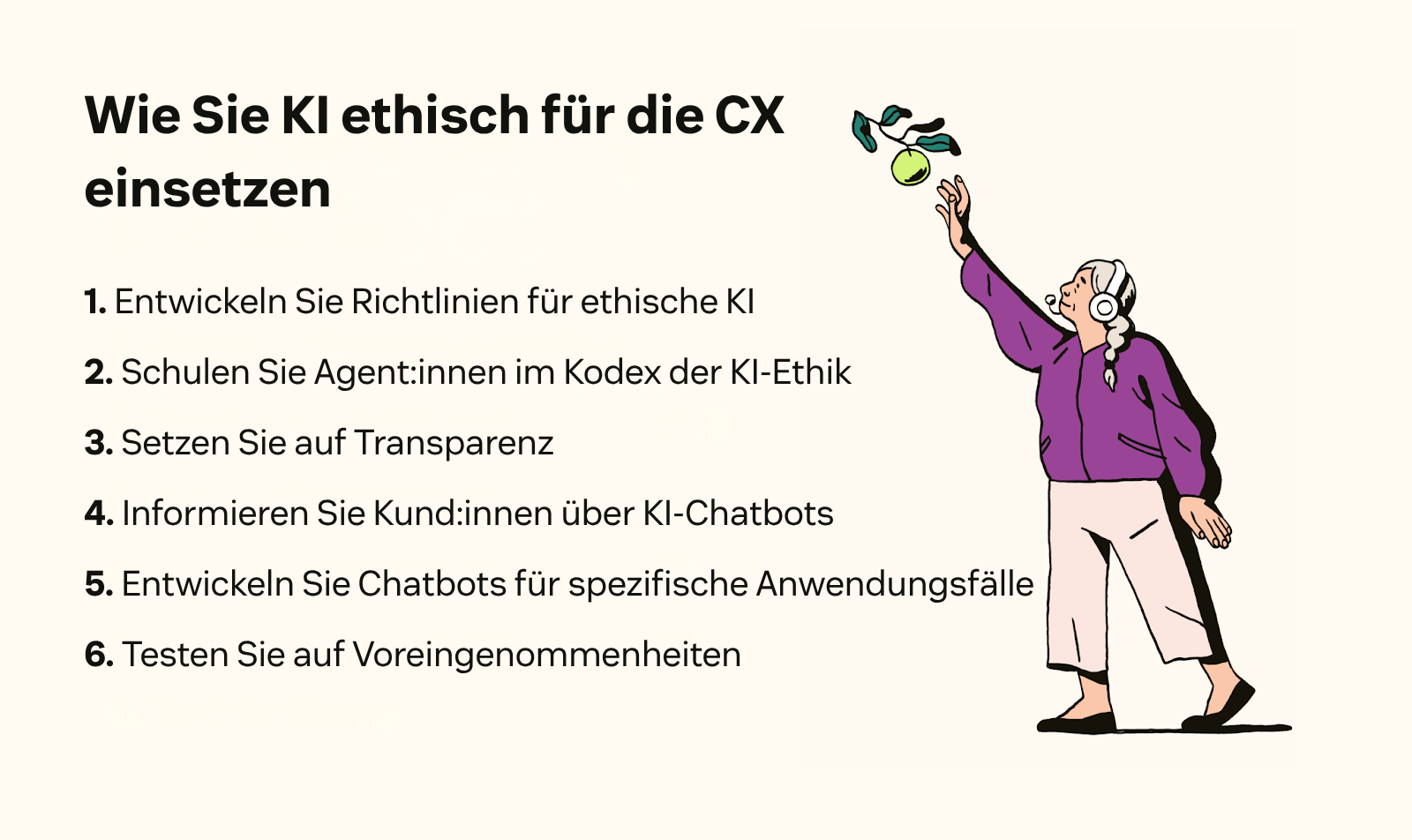

6 Tipps für den ethischen KI-Einsatz in der CX

Nachdem Sie nun verstehen, was KI-Ethik bedeutet und warum sie in der CX-Welt so wichtig ist, ist es an der Zeit, Künstliche Intelligenz als Superkraft im Kundenservice einzusetzen. Für alle, die ihr Superteam aus Agent:innen mit KI unterstützen möchten, haben wir sechs Tipps zusammengestellt, um ethische Stolperfallen zu vermeiden.

1. Entwickeln Sie Richtlinien für ethische KI

Eine der besten Möglichkeiten, sicherzustellen, dass Sie KI ethisch für die CX einsetzen, besteht darin, einen Kodex für den ethischen Umgang mit KI zu entwickeln. Diese Leitlinien können je nach Einsatzgebiet variieren, umfassen aber in der Regel:

Einhaltung von Datenschutzvorschriften

Priorisierung von Transparenz

Sicherung von Fairness, Vielfalt und Inklusion

Gewährung der Möglichkeit für Nutzer:innen, KI-Interaktionen abzulehnen

Verpflichtung zu kontinuierlichen Tests und Audits

Sind Ihre Richtlinien zur KI-Ethik im Unternehmen festgelegt, können sie den Stakeholder:innen als Orientierung dienen, wenn KI in der CX implementiert wird.

2. Schulen Sie Ihre Kundenservice-Agent:innen im Kodex der KI-Ethik

Nachdem Sie Ihre KI-Leitlinien erstellt haben, sollten Sie Ihre Mitarbeitenden über die ethischen Aspekte des KI-Einsatzes in der CX aufklären – denn Maschinen arbeiten nur mit den Informationen, die wir ihnen geben.

„Sie geben nur das wieder, was bereits vorhanden ist“, sagt Mikey Fischer, der ein System entwickelt hat, das natürliche Sprache in Code übersetzt, und kürzlich seine Promotion in Informatik an der Stanford University mit Schwerpunkt KI und Sprachverarbeitung abgeschlossen hat.

Laut Fischer ist es deshalb wichtig, Menschen in den Prozess einzubeziehen, um KI-Bias auch nach Tests zu bewerten – sicherzustellen, dass das System für spezifische Nutzer:innen funktioniert und Einzelfälle berücksichtigt, statt nur globale Durchschnittswerte.

Hilfreich ist auch ein Fallback-System, damit Kund:innen bei unerwarteten oder ungenauen Ergebnissen eine reale Person erreichen können.

3. Entscheiden Sie sich für Transparenz und Erklärbarkeit

Unabhängig davon, wofür ein Unternehmen KI nutzt, muss es Transparenz über den KI-Einsatz und Erklärbarkeit geben – also darüber, warum ein KI-System eine bestimmte Entscheidung getroffen hat.

„Unternehmen, die mit ihrer Technologie transparent umgehen oder sie offen zugänglich machen, geraten seltener in Schwierigkeiten“, erklärt Fischer. „Probleme entstehen meist dann, wenn Unternehmen zu viel versprechen oder Dinge verbergen – nicht, weil die Technologie unvollkommen ist. Jeder versteht, dass Technologie Grenzen hat.“

Wie Unternehmen offen über Preise oder Werte kommunizieren, sollten sie auch transparent über den Einsatz von KI informieren – was ihre Technologie kann und was nicht, sowie über die internen Prozesse dahinter. Dazu gehört auch, ehrlich zu sein, wenn etwas schiefläuft.

4. Informieren Sie Kund:innen, wenn sie mit einem KI-Chatbot interagieren

Transparente Unternehmen stellen zudem sicher, dass Kund:innen wissen, wenn sie mit KI interagieren, so Fischer. Beispielsweise verpflichtet das „B.O.T.-Gesetz“ Unternehmen in Kalifornien dazu, Konsument:innen mitzuteilen, wenn sie mit einem Chatbot statt mit einem Menschen sprechen.

So müssen Kund:innen nie darüber rätseln, ob sie mit einem Chatbot oder einem Service-Agent:innen sprechen. Das wird immer wichtiger, da laut unserem CX Trends Report 65 Prozent der Führungskräfte glauben, dass ihre eingesetzte KI-Technologie zunehmend menschlicher wirkt.

5. Entwickeln Sie Chatbots, die kontextbezogen und auf den Anwendungsfall abgestimmt sind

Unternehmen können Verzerrungen verringern, indem sie KI-Technologien entwickeln, die kontextuell relevant und auf spezifische Anwendungsfälle zugeschnitten sind.

„Wenn KI für eine zu breit angelegte Aufgabe eingesetzt wird, kann sie gar nicht unbeeinflusst sein, da Ethik immer kontextabhängig ist“, sagt Fischer. „Wenn wir alle in eine technologische Monokultur gezwungen werden, kann KI die Nuancen unterschiedlicher Zielgruppen gar nicht vollständig erfassen.“

Beispiele für domänenspezifische Chatbots – also Chatbots, die für bestimmte Aufgaben konzipiert sind – sind „Erica“ von Bank of America, die Kund:innen bei der Verwaltung ihrer Finanzen unterstützt, oder der WhatsApp-Bot der Weltgesundheitsorganisation (WHO), der verlässliche Informationen zu COVID-19 bereitstellt.

„Es geht darum, nutzer- und kontextbezogen zu arbeiten, sodass der Chatbot über ausreichend Hintergrundwissen verfügt, um ethisch handeln zu können“, erklärt Fischer. „Hat er eine klar definierte Aufgabe, entsteht ein besseres gegenseitiges Verständnis zwischen System und Nutzer:in.“

6. Bewerten Sie KI im Abgleich mit Ihren eigenen Voreingenommenheiten

KI-Technologien lernen aus den Daten, die wir ihnen geben – sie lernen die Welt, wie sie ist oder war, nicht unbedingt, wie sie sein sollte. Dadurch übertragen wir unsere bewussten oder unbewussten Vorurteile.

„Ein völlig neutrales System gibt es nicht“, erklärt Fischer. „KI basiert immer auf einer Definition von Fairness, die sie zu optimieren versucht – und davon gibt es viele.“

Als Beispiel nennt Fischer einen Chatbot zur Beurteilung der Kreditwürdigkeit. Definieren Sie Kreditwürdigkeit als Wahrscheinlichkeit, dass jemand einen Kredit zurückzahlt, oder optimieren Sie auf maximalen Gewinn?

Selbst wenn wir glauben, KI ohne Bias zu programmieren, kann sie Vorurteile übernehmen, die uns gar nicht bewusst sind.

„KI-Systeme haben Millionen von Parametern, und es ist oft nicht sofort ersichtlich, warum eine bestimmte Entscheidung getroffen wurde“, sagt Fischer. „Selbst die sorgfältigsten Entwickler:innen können ein System erschaffen, das sich völlig anders verhält als erwartet.“

Ein Beispiel: Eine Bank könnte feststellen, dass ihr Algorithmus zur Kreditwürdigkeit rassistische Verzerrungen enthält, und das Merkmal „Ethnie“ entfernen. Doch der Algorithmus kann dies statistisch über andere Daten ableiten – etwa über Wohnort oder Hochschule.

„Es ist schwer, diskriminierende Faktoren vollständig auszuschließen“, so Fischer. Deshalb sollten alle, die für die Entwicklung zukünftiger KI-Erlebnisse verantwortlich sind, Chatbots regelmäßig im Hinblick auf ihre eigenen Vorurteile bewerten.

Häufig gestellte Fragen

Agent:innen mit ethischer KI stärken

Während der Einsatz von KI im Kundenservice die Customer Experience verbessern und Ihre Supportprozesse optimieren kann, ist es entscheidend, dies verantwortungsvoll und ethisch zu tun – mit Empathie, Vielfalt und Datenschutz im Mittelpunkt.

Wenn Sie Ihre menschlichen Agent:innen mit KI stärken, erweitern Sie deren Fähigkeiten und ermöglichen bedeutungsvolle automatisierte Kundenbetreuung, während Sie gleichzeitig Produktivität, Kundenzufriedenheit und Effizienz steigern – und dabei Zeit und Kosten sparen.